MouseSound

MouseSound

Updated 12 June 2006 for Mac OS X (10.2 and later).

T100 [ Download ] /peg

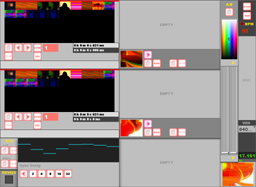

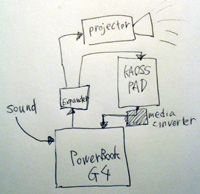

This environmental application is generating sounds by mouse movement.

---

os9時代はマウスアクションに応じて音を鳴らす機能がありました。

os9時代はマウスアクションに応じて音を鳴らす機能がありました。

何かをクリックしたらあるサンプルを再生するだけのシンプルなものでしたけど。

MouseSoundはマウスの動かし方に応じて音を生成しているので、激しく動かせば、音も激しくなります。

Demo Movieちなみにマウス遍歴

一時期、Maxパッチの書き過ぎで、手首が痛くなってしまったので、腕で動かすマウスをやめて手のみで動かせるトラックボールに変えた。

馴れまでの時間あったけど、現在はマシンの台数分所持して常時使用してる。

追記:

追記: